Intelligenza artificiale: supererà l'esame di guida?

L'intelligenza artificiale è presente in un numero sempre maggiore di settori della nostra vita quotidiana. Supererebbe l'esame di guida?

Mercedes-Benz vuole sperimentare l'intelligenza artificiale (AI) nella produzione di automobili. Bosch sottolinea che l'auto di oggi è il vero geek, perché l'AI impara tre volte più velocemente di un umano al volante. Da tempo è a bordo per lo streaming musicale, la navigazione e gli assistenti vocali digitali, e la guida autonoma è inconcepibile senza l'AI. Dobbiamo abituarci al copilota che sa tutto e può fare tutto meglio di noi?

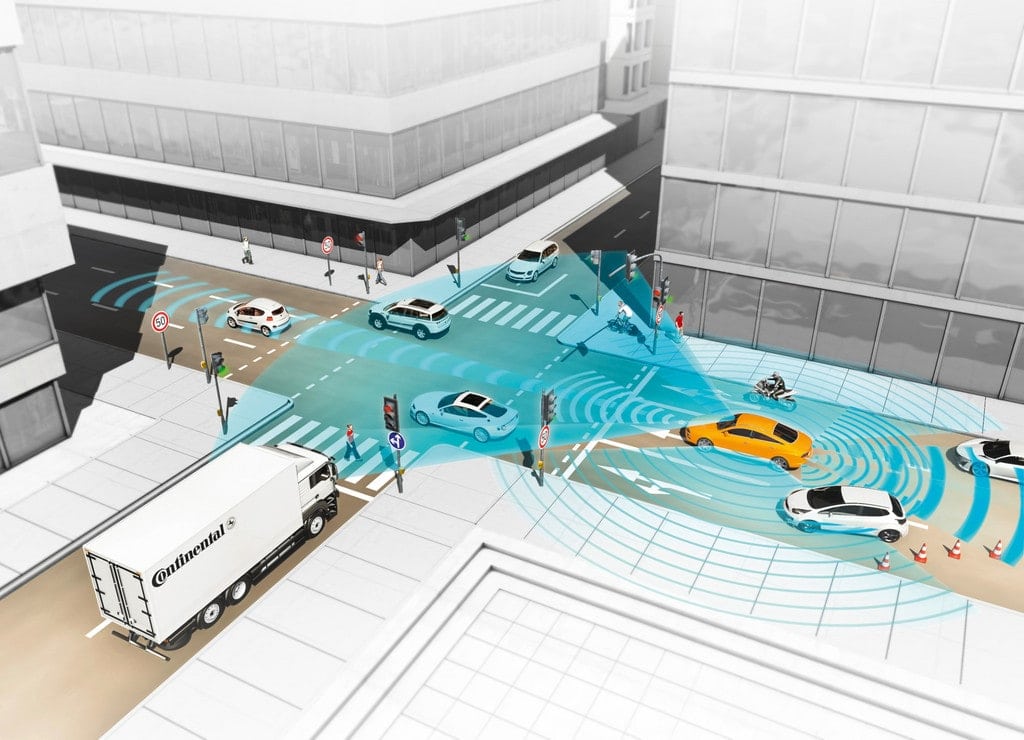

Guida completamente automatizzata o autonoma per una maggiore sicurezza. Foto: Auto-Medienportal.Net/Continental

Riconoscere i pedoni

Il Prof. Dr. Simon Burton, Direttore Scientifico Safety Assurance, Fraunhofer IKS Munich, sa che l'IA è di importanza cruciale per la guida autonoma e altamente automatizzata, "perché i sistemi basati sull'IA garantiscono che i veicoli autonomi possano affrontare gli scenari complessi del traffico stradale". I veicoli autonomi devono percepire l'ambiente circostante e reagire in modo appropriato. Ad esempio, è importante che i pedoni vengano riconosciuti senza errori in ogni momento e che da ciò derivi la risposta corretta.

Sicuri in ogni momento?

Ma quando si parla dell'uso dell'IA nei veicoli autonomi, il professor Burton si pone la domanda: "È dimostrabile che l'IA sia sufficientemente sicura per essere utilizzata in un settore critico per la sicurezza come il traffico stradale?". Dopo tutto, non è facile riconoscere come i sistemi di IA giungano a una conclusione e anche lievi modifiche ai dati di input, ad esempio, portano a un risultato completamente diverso. "Nel traffico stradale, tuttavia, le decisioni dell'IA devono essere comprensibili e la sicurezza funzionale deve essere garantita in ogni momento", chiede l'uomo del Fraunhofer.

Guida autonoma. Foto: Auto-Medienportal.Net/Continental

Oggi l'intelligenza artificiale sta dimostrando le sue capacità nell'automobile e in molti altri campi di applicazione: nell'industria per il controllo di dispositivi e macchine, nella robotica, nei processi di automazione e persino nella medicina, dove fornisce un valido supporto ai medici, in particolare nella diagnostica. Oppure sotto forma di app per la salute, che fanno già parte dello stile di vita di alcune persone. Allo stesso tempo, le discussioni sui limiti e sui rischi dell'IA continuano a crescere.

Riconoscere dove fallisce

In un saggio pubblicato sull'attuale numero 619 della rivista scientifica "Nature", Celeste Biever spiega come gli LLM (Large Language Model) basati sull'intelligenza artificiale falliscano in compiti relativamente semplici dei test di intelligenza standardizzati. Il fatto che i modelli che superano senza sforzo gli esami di ammissione di rinomate università e padroneggiano a tempo di record requisiti complicati in molti settori falliscano regolarmente in semplici compiti di astrazione sta facendo scalpore. Il suo appello in questo contesto: "Dobbiamo capire fondamentalmente cosa possono fare e dove falliscono". Sullo sfondo c'è la questione se i sistemi di intelligenza artificiale possano essere classificati come "geni" illimitati o se le capacità dell'intelligenza artificiale non siano poi così limitate.

Entrambi, afferma il Prof. Marco Barenkamp, esperto di IA e Vice Presidente del Consiglio di Sorveglianza e fondatore della LMIS AG di Osnabrück, specializzata nell'applicazione dell'IA nell'industria.

ChatGPT vs. umano

ChatGPT della start-up statunitense OpenAI o Bard di Google, così come altri LLM, hanno padroneggiato molte abilità che sarebbero state celebrate come una pietra miliare dell'intelligenza artificiale solo pochi anni fa, il Prof. Barenkamp spiega l'importanza di questo sviluppo: i bot rispondono alle domande in modo eloquente e stupiscono per la loro sorprendente conoscenza generale. Tuttavia, il modello di trasformatore "Chat Generative Pre-trained Transformer", che è il nome completo di ChatGPT, ha già notevoli difficoltà con semplici puzzle di logica visiva, mentre gli esseri umani di solito padroneggiano tali compiti senza sforzo. Questa è una caratteristica che i normali automobilisti dovrebbero temere.

Valutare realisticamente l'IA

In questo contesto, gli scienziati si stanno attualmente interrogando su come valutare realisticamente le capacità di ChatGPT. Il Prof. Barenkamp fa riferimento a uno studio che ha recentemente attirato l'attenzione del mondo accademico e che è anche alla base del saggio di Celeste Biever: un team guidato da Melanie Mitchell del Santa Fe Institute ha sottoposto al modello linguistico GPT 4 dei compiti in cui i blocchi colorati dovevano essere disposti in una griglia. Diversi esempi sono stati utilizzati per dedurre la regola sottostante e prevedere come i blocchi sarebbero cambiati successivamente.

"La maggior parte delle persone risolve questi compiti senza sforzo", spiega il Prof. Barenkamp. Il GPT 4, invece, è riuscito a risolvere correttamente solo un terzo dei compiti in una categoria e solo il 3% in altre. Altri sistemi di intelligenza artificiale sviluppati appositamente per questi rompicapo hanno ottenuto risultati migliori, ma comunque significativamente peggiori rispetto agli esseri umani.

Lo studio dimostra che attualmente è ancora difficile per i sistemi artificiali riconoscere i concetti sottostanti e imparare da essi, riassume l'esperto Barenkamp. Tuttavia, uno dei tratti distintivi dell'intelligenza umana è proprio la capacità di astrarre e trasferire a nuove situazioni, sottolinea.

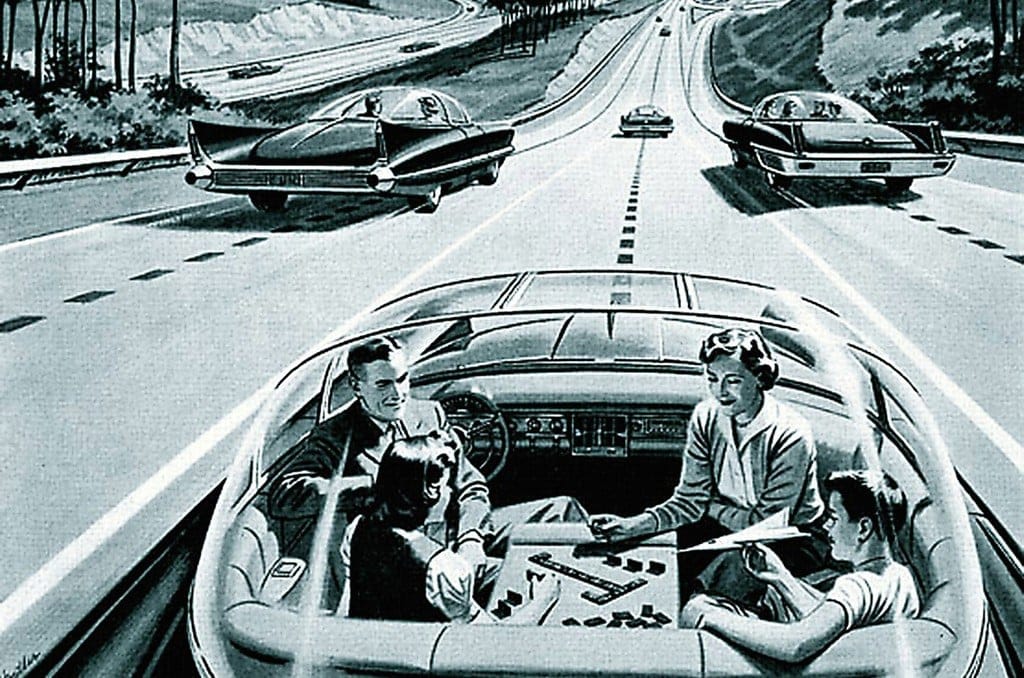

Guida autonoma: Un sogno degli anni '50. Foto: Auto-Medienportal.Net/Wikipedia

Apprendere in modo diverso dagli esseri umani

Perché i sistemi di IA sono ancora così chiaramente inferiori agli esseri umani in queste abilità di base, mentre a volte stupiscono con una sorprendente eloquenza nelle conversazioni? Il Prof. Barenkamp lo spiega dicendo che le applicazioni di IA apprendono in modo diverso dagli esseri umani. Ad esempio, i modelli linguistici di grandi dimensioni, come il GPT 4, vengono addestrati esaminando enormi quantità di testo. In questo modo, l'intelligenza artificiale riconosce le correlazioni statistiche tra le parole, come spiega il Prof. Barenkamp, per determinare la parola successiva più probabile in base a un input. Gli esseri umani, invece, già da bambini fanno esperienze concrete con oggetti e situazioni, costruiscono una propria immagine (rappresentazione) del mondo e sviluppano abilità cognitive come la capacità di astrarre e pensare logicamente.

Secondo l'esperto di IA Barenkamp, questo potrebbe spiegare perché il GPT 4 è in grado di produrre testi di alta qualità, come quelli scritti dagli esseri umani, ma non riesce a superare semplici test visivi: perché l'addestramento in questo caso si basa esclusivamente sul linguaggio e non su esperienze reali e sulla necessaria connessione del linguaggio con cose concrete e vissute. Alcuni ricercatori sospettano quindi che i sistemi di intelligenza artificiale non "capiscano" le parole allo stesso modo degli esseri umani, perché questo impedisce loro di sviluppare una reale concettualizzazione del mondo.

Quindi, per dirla in modo sarcastico: l'IA può dirci molto, ma i processi nel traffico potrebbero essere ancora troppo complessi per lei. Nei prossimi anni, gli automobilisti probabilmente sperimenteranno l'IA più nell'ambito della comodità dei sistemi di infotainment e di assistenza. La strada verso la guida completamente automatizzata è probabilmente più lunga di quanto pensassero i responsabili di San Francisco, che hanno autorizzato l'uso di taxi autonomi e ora devono fare i conti con gli ingorghi a causa dei distributori automatici di taxi.

(aum)

Ulteriori link: